Les assistants vocaux comme Alexa, Google Assistant et Siri ont parcouru un long chemin au cours des dernières années. Mais, malgré toutes leurs améliorations, une chose les retient: ils ne vous comprennent pas. Ils s’appuient trop sur des commandes vocales spécifiques.

Table des matières

La reconnaissance vocale n’est qu’un tour de magie

Les assistants vocaux ne vous comprennent pas. Pas vraiment, en tout cas. Lorsque vous parlez à un Google Home ou Amazon Echo, il convertit essentiellement vos mots en une chaîne de texte, puis les compare aux commandes attendues. S’il trouve une correspondance exacte, il suit un ensemble d’instructions. Si ce n’est pas le cas, il recherche une alternative à la marche à suivre en fonction des informations dont il dispose, et si cela ne fonctionne pas, vous obtenez un message d’échec tel que « Je suis désolé, mais je ne sais pas cela . » Ce n’est guère plus qu’un tour de passe-passe pour vous faire croire qu’il comprend.

Il ne peut pas utiliser d’indices contextuels pour faire la meilleure estimation, ni même utiliser une compréhension de sujets similaires pour éclairer ses décisions. Il n’est pas non plus difficile de faire trébucher les assistants vocaux. Alors que vous pouvez demander à Alexa « Travaillez-vous pour la NSA? » et obtenez une réponse, si vous demandez « Faites-vous secrètement partie de la NSA? » vous obtenez une réponse «Je ne sais pas celle-là» (au moins au moment de la rédaction de cet article).

Les humains, qui comprennent vraiment la parole, ne fonctionnent pas comme ça. Supposons que vous demandiez à un humain: «Qu’est-ce que ce klarvain dans le ciel? Celui qui est arqué et plein de couleurs rayées comme le rouge, l’orange, le jaune et le bleu. » Bien que klarvain soit un mot inventé, la personne à qui vous avez demandé pourrait probablement comprendre dans le contexte que vous décrivez un arc-en-ciel.

Alors que vous pourriez affirmer qu’un humain convertit la parole en idées, un humain peut alors appliquer ses connaissances et sa compréhension pour conclure une réponse. Si vous demandez à un humain s’il travaille secrètement pour la NSA, il vous répondra par oui ou par non, même si cette réponse est un mensonge. Un humain ne dirait pas «je ne connais pas celui-là» à une question comme celle-là. Que les humains puissent mentir est quelque chose qui vient avec une réelle compréhension.

Les assistants vocaux ne peuvent pas aller au-delà de leur programmation

Les assistants vocaux sont finalement limités aux paramètres prévus programmés, et s’éloigner d’eux interrompra le processus. Cela montre quand des appareils tiers entrent en jeu. Habituellement, la commande pour interagir avec ceux-ci est très compliquée, ce qui revient à «demander au fabricant de l’appareil de commander un argument facultatif». Un exemple exact serait: « Dites à Whirlpool de mettre le sèche-linge en pause. » Pour un exemple encore plus difficile à retenir, le Compétence Alexa de Genève contrôle certains fours GE. Un utilisateur de la compétence doit se souvenir de «dire à Genève» et non de «dire à GE» puis le reste de la commande. Et bien que vous puissiez lui demander de préchauffer le four à 350 degrés, vous ne pouvez pas donner suite à une demande d’augmentation de la température de 50 degrés supplémentaires. Un humain pourrait cependant suivre ces demandes.

Amazon et Google ont travaillé très dur pour surmonter ces obstacles, et cela se voit. Alors qu’une fois que vous deviez suivre la séquence ci-dessus pour contrôler une serrure intelligente, vous pouvez maintenant dire «verrouiller la porte d’entrée» à la place. Alexa avait l’habitude d’être confuse par «racontez-moi une blague de chien», mais demandez-en une aujourd’hui et cela fonctionnera. Ils ont ajouté des variantes aux commandes que vous utilisez, mais en fin de compte, vous devez toujours connaître la bonne commande à prononcer. Vous devez utiliser la syntaxe correcte, dans le bon ordre.

Et si vous pensez que cela ressemble beaucoup à une ligne de commande, vous n’avez pas tort.

Les assistants vocaux sont une ligne de commande sophistiquée

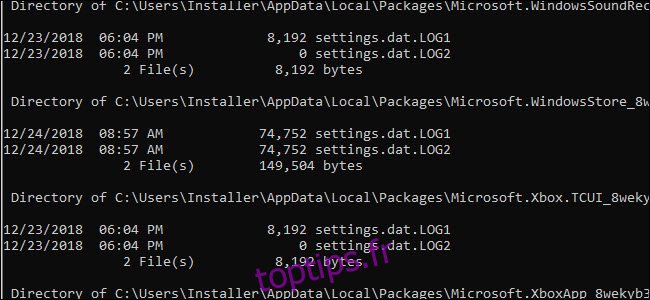

Une ligne de commande est étroitement définie pour effectuer des tâches simples, mais uniquement si vous connaissez la syntaxe appropriée. Si vous sortez de cette syntaxe correcte et tapez dyr au lieu de dir, l’invite de commande vous donnera un message d’erreur. Vous pouvez utiliser des alias pour des commandes plus faciles à mémoriser, mais vous devez avoir une idée de ce qu’étaient les commandes d’origine, de leur fonctionnement et de l’utilisation efficace des alias. Si vous ne prenez pas le temps d’apprendre les tenants et les aboutissants de la ligne de commande, vous n’en tirerez jamais grand-chose.

Les assistants vocaux ne sont pas différents. Vous devez connaître la bonne façon de dire une commande ou de poser une question. Et vous devez savoir comment configurer des groupes pour Google et Alexa, pourquoi le regroupement de vos appareils est essentiel et comment nommer vos appareils intelligents. Si vous ne suivez pas ces étapes nécessaires, vous ressentirez la frustration de demander à votre assistant vocal d’éteindre l’étude uniquement pour qu’on lui demande «quelle étude» devrait être désactivée.

Même lorsque vous utilisez la syntaxe correcte dans le bon ordre, le processus peut échouer. Soit avec une mauvaise réponse, soit un résultat surprenant. Deux Google Homes dans la même maison peuvent donner des conditions météorologiques pour des endroits légèrement différents, même s’ils ont accès aux mêmes informations de compte utilisateur et à la même connexion Internet.

Dans l’exemple ci-dessus, la commande «Régler une minuterie pour une demi-heure» est donnée. Le hub Google Home a créé un minuteur nommé « Heure », puis a demandé combien de temps le minuteur devrait durer. Et pourtant, répéter la même commande trois autres fois fonctionnait correctement et créait une minuterie de 30 minutes. L’utilisation de la commande «Régler une minuterie sur 30 minutes» fonctionne correctement de manière plus cohérente.

Bien que parler à un Google Home ou à un écho puisse être plus fluide, les assistants vocaux et les lignes de commande sous le capot fonctionnent de la même manière. Vous n’avez peut-être pas besoin d’apprendre une nouvelle langue, mais vous devez apprendre un nouveau dialecte.

La compréhension étroite des assistants vocaux limitera la croissance

Rien de tout cela n’empêche les assistants vocaux comme Google Assistant et Alexa de fonctionner suffisamment bien (bien que Cortana soit une autre histoire). Google Assistant et Alexa et recherchez en ligne des questions de manière décente, mais sans surprise, Google est meilleur en recherche et peut répondre à des questions de base telles que les conversions de mesure et les mathématiques simples. Avec une maison intelligente correctement configurée et un utilisateur bien formé, la plupart des commandes de maison intelligente fonctionneront comme prévu. Mais cela est venu grâce au travail et aux efforts, et non à la compréhension intellectuelle.

Les minuteries et les alarmes étaient auparavant simplistes. Au fil du temps, la dénomination a été ajoutée, puis la possibilité d’ajouter du temps à une minuterie. Ils sont passés du simpliste au plus compliqué. Les assistants vocaux peuvent répondre à plus de questions et chaque jour apporte de nouvelles compétences et fonctionnalités. Mais ce n’est pas le produit de la croissance personnelle qui vient de l’apprentissage et de la compréhension.

Et rien de tout cela n’offre la capacité inhérente d’utiliser ce que l’on sait pour atteindre l’inconnu. Pour chaque commande et question qui fonctionnent, il y en aura toujours trois qui ne fonctionnent pas. Sans une percée dans l’IA qui confère une capacité de compréhension humaine, les assistants vocaux ne sont pas du tout des assistants. Ce ne sont que des lignes de commande vocales – utiles dans le bon scénario mais limitées aux scénarios pour lesquels elles ont été programmées.

En d’autres termes: les machines apprennent des choses, mais ne peuvent pas les comprendre.