Les assistants vocaux, tels que Google Assistant et Alexa, fonctionnent en enregistrant vos propos dès qu’ils entendent leur mot-clé d’activation, pour ensuite les transmettre aux serveurs de l’entreprise concernée. Ces enregistrements sont conservés jusqu’à ce que vous décidiez de les supprimer. Toutefois, certaines entreprises offrent la possibilité de désactiver cette fonctionnalité. Découvrons comment procéder.

Fonctionnement de l’enregistrement vocal par les assistants

Le principe des assistants vocaux est simple : ils sont constamment à l’écoute de tout ce qui se dit autour d’eux. Cependant, l’appareil lui-même ne possède qu’une faible capacité de traitement. Il est seulement conçu pour identifier son mot-clé de réveil, comme « Alexa », « Hey Google » ou « Hey Cortana ».

Dès qu’il détecte ce mot-clé, l’assistant commence à enregistrer tout ce qui suit, y compris une brève portion précédant la détection effective. Cet enregistrement est ensuite envoyé aux serveurs de l’entreprise afin d’être analysé et de permettre à l’assistant d’exécuter vos commandes.

Après avoir effectué la tâche demandée, ces enregistrements ne sont pas systématiquement effacés. Au contraire, ils sont conservés indéfiniment dans le but d’améliorer les performances de l’assistant et de développer de nouvelles fonctionnalités.

Certaines entreprises permettent de désactiver cette conservation des données, tandis que d’autres ne le proposent pas. Parmi celles qui le permettent, la désactivation de cette fonctionnalité peut parfois compromettre le bon fonctionnement de l’assistant, mais ce n’est pas toujours le cas. Nous allons examiner les options disponibles et leurs implications.

Google : le choix et la transparence

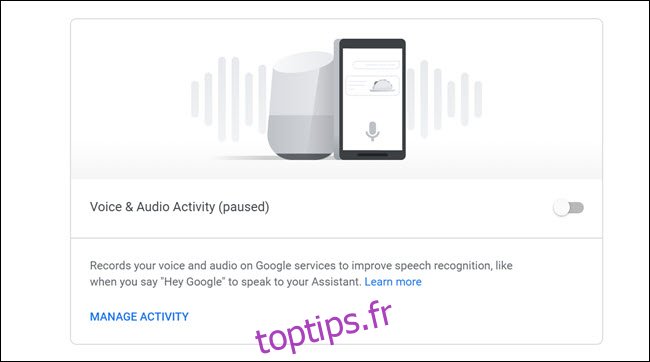

Google se distingue en offrant la possibilité d’utiliser Google Assistant sans pour autant stocker vos données vocales de manière permanente. Cette approche est désormais la configuration par défaut pour les nouveaux utilisateurs.

Les utilisateurs existants peuvent également désactiver ce stockage. Pour cela, il suffit de se rendre dans les Paramètres d’activité de Google, puis de désactiver l’option « Activité vocale et audio » et de cliquer sur « Suspendre ».

De plus, désactiver le stockage de la voix n’affecte pas le fonctionnement de Google Assistant ou de Google Home. Il n’y a donc aucune raison de ne pas le faire si vous êtes préoccupé par la conservation de vos données par les grandes entreprises.

Alexa : un contrôle limité sur les enregistrements

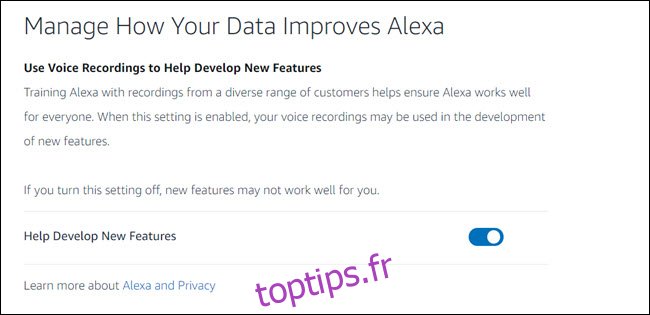

Contrairement à Google, Amazon n’offre pas la possibilité d’empêcher le stockage de vos enregistrements vocaux. Si vous utilisez Alexa, que ce soit sur un appareil Echo ou via l’application, votre voix est traitée et envoyée aux serveurs d’Amazon, où elle est conservée pour améliorer le fonctionnement de l’assistant.

Les seules options disponibles sont la consultation et la suppression de vos enregistrements, ou bien le fait de ne pas utiliser d’appareil compatible avec Alexa. Il est possible de désactiver les appareils Echo, mais cette solution n’est pas permanente. De plus, elle neutralise complètement l’utilité de l’appareil.

Amazon met à disposition un tableau de bord de confidentialité, où vous pouvez indiquer à l’entreprise de ne pas utiliser vos enregistrements vocaux pour développer de nouvelles fonctionnalités ou améliorer les transcriptions. Cette option ne vous permet cependant pas d’empêcher le stockage de vos enregistrements ou leur utilisation à d’autres fins.

Mise à jour : Amazon propose désormais la suppression de certains enregistrements vocaux.

Espérons qu’Amazon suivra l’exemple de Google et proposera davantage de contrôle sur nos données.

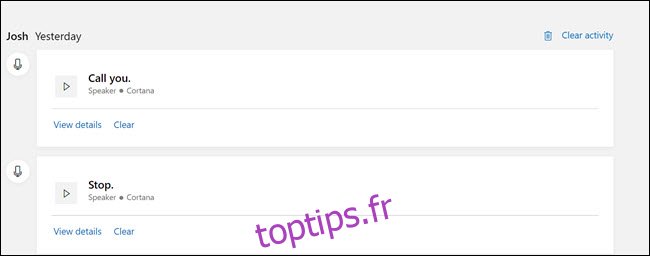

Cortana : la seule option est la désactivation

À l’instar d’Amazon, Microsoft ne propose pas de solution pour éviter le stockage de vos enregistrements vocaux. Vous pouvez uniquement consulter et supprimer les enregistrements via le tableau de bord de confidentialité de Microsoft.

Pire qu’Amazon, vous ne pouvez même pas limiter l’utilisation de vos enregistrements par Microsoft. La seule alternative est de désactiver complètement « Hey Cortana ». Pour cela, tapez « Parler à Cortana » dans la barre de recherche du menu Démarrer, puis désactivez l’option « Hey Cortana ».

Si vous utilisez un haut-parleur Cortana, vous devrez le désactiver également. Ce faisant, vous renoncez complètement à l’utilisation de Cortana. Si vous souhaitez utiliser l’assistant, vous devez accepter le stockage de vos données vocales par Microsoft.

Siri : suppression des enregistrements après désactivation

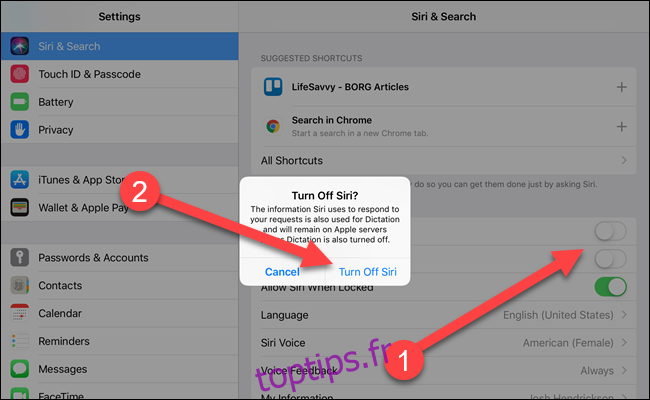

Apple offre la possibilité de supprimer facilement vos enregistrements, mais peu d’options pour empêcher leur enregistrement initial. À l’instar de Microsoft et d’Amazon, la seule façon d’empêcher Apple de stocker vos données vocales est de ne pas utiliser Siri. En utilisant Siri, vous consentez à ce qu’Apple utilise vos enregistrements vocaux à toutes fins qu’elle juge appropriées.

Cependant, la bonne nouvelle est que la simple désactivation de Siri supprime vos enregistrements des serveurs d’Apple. Pour cela, il est également nécessaire de désactiver la dictée.

Pour désactiver Siri, allez dans « Réglages > Siri » et désactivez « Hey Siri » ainsi que « Siri ». Confirmez en appuyant sur « Désactiver ». Notez que les enregistrements ne sont pas supprimés si la dictée est activée.

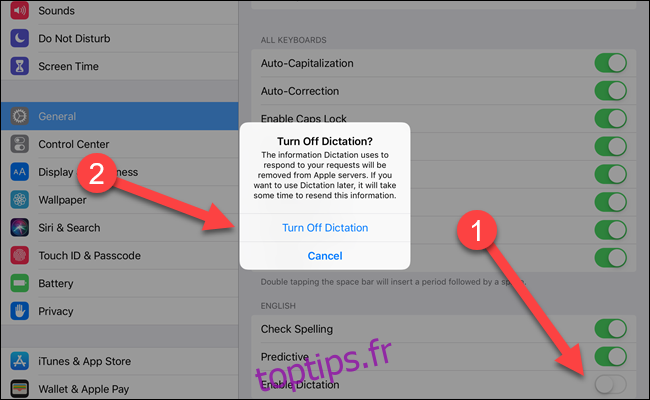

Ensuite, désactivez la dictée en allant dans « Réglages > Général > Claviers » et désactivez la dictée. Confirmez en appuyant sur « Désactiver ». Il vous sera alors indiqué que vos enregistrements seront supprimés. Si vous faites les manipulations dans l’ordre inverse, les avertissements s’adapteront en conséquence.

En conclusion, tous les assistants vocaux ne se valent pas. Siri permet de supprimer facilement les enregistrements, mais Google se démarque en offrant la possibilité de désactiver leur stockage tout en continuant à utiliser l’assistant. Il est souhaitable que les entreprises s’inspirent des pratiques les plus respectueuses de la vie privée et proposent davantage de contrôle sur nos données.