Qu’est-ce qu’une arnaque familiale AI Voice Clone ? Comment le repérer

Points essentiels à retenir

- L'escroquerie par imitation vocale utilise l'intelligence artificielle pour reproduire des voix de manière très convaincante, jouant sur les émotions et le sentiment d'urgence.

- Les escrocs exploitent les informations publiées sur les plateformes sociales pour construire des scénarios réalistes et manipuler les liens interpersonnels.

- Soyez vigilant et familiarisez-vous avec les signes révélateurs de ces fraudes par imitation vocale; terminez les appels suspects et vérifiez les messages d'appel à l'aide.

Imaginez : il est tard le soir, et vos parents reçoivent un message vocal alarmant de votre part, indiquant que vous êtes en difficulté, que votre portefeuille a été dérobé et que vous êtes bloqué dans un endroit inconnu. De l'argent doit être transféré immédiatement pour vous permettre de rentrer chez vous.

La voix dans le message semble authentique, celle de leur enfant sans l'ombre d'un doute, mais c'est une illusion. Il s'agit d'une réplique vocale créée par l'IA, et ils sont devenus la cible d'une escroquerie aussi moderne qu'efficace.

Comment fonctionne une arnaque par clonage vocal basé sur l'IA ?

Le clonage vocal est capable de générer des copies numériques extrêmement réalistes de la voix d'une personne. Cette technique, souvent appelée audio "deepfake", est réalisée à l'aide d'outils de clonage vocal IA comme ElevenLabs. En l'associant à l'IA générative et à la synthèse vocale, la voix clonée peut reproduire les émotions, les nuances, l'intonation et même la peur.

Pour référence, voici l'apparence et la voix de Christian Cawley, lors d'une intervention sur le podcast The Really Useful Podcast.

Pour créer un clone vocal IA, un court échantillon de voix est nécessaire, parfois une minute ou moins. Ces échantillons vocaux sont fréquemment extraits de publications publiques sur les réseaux sociaux, ce qui rend les vidéoblogueurs et les influenceurs particulièrement vulnérables en raison de la haute qualité audio de leurs contenus, facilement accessibles.

Une fois l'échantillon vocal cloné, les fraudeurs utilisent la synthèse vocale ou même la synthèse vocale en temps réel pour générer de faux appels et messages vocaux.

Après avoir consulté les profils sociaux de la victime et collecté ses données personnelles, l'escroc élabore un scénario convaincant. Il peut s'agir d'une hospitalisation, d'une arrestation, d'un vol, d'un enlèvement – tout ce qui génère de l'angoisse. La voix clonée est ensuite employée pour manipuler un membre de la famille en lui faisant croire qu'un être cher se trouve en situation de détresse grave.

Le réalisme de la voix et des émotions, combiné au choc et à l'urgence de la demande, peut inhiber le scepticisme, menant à des décisions précipitées comme le transfert d'argent ou la divulgation d'informations sensibles.

Pourquoi les escroqueries par clonage vocal IA sont-elles si efficaces ?

Comme la plupart des escroqueries ciblant les proches, l'arnaque au clonage vocal par IA est efficace car elle exploite les relations personnelles. La panique suscitée par un appel de détresse d'un proche peut rapidement altérer le jugement, menant à des décisions irréfléchies. C'est la même méthode utilisée dans les escroqueries d'usurpation d'identité, mais l'effet est amplifié par le fait d'entendre la voix d'un proche.

Les familles de personnes très présentes sur les réseaux sociaux ou voyageant fréquemment sont particulièrement exposées, car leur situation fournit un contexte plausible au récit fabriqué par l'escroc. Les fraudeurs collectent et utilisent souvent à l'avance les informations personnelles de leurs cibles sur leurs comptes de médias sociaux publics, ce qui rend leurs histoires d'autant plus crédibles.

Signes clés d'une escroquerie par clonage vocal IA

Malgré leur sophistication, les escroqueries par clonage vocal IA peuvent être démasquées par des signaux d'alerte précis :

- Urgence : l'escroc vous convaincra qu'une catastrophe se produira si des mesures immédiates ne sont pas prises.

- Détails : les fraudeurs ne connaissent pas toujours toute l'histoire de votre relation avec la cible, soyez attentif aux incohérences.

- Demandes atypiques : les demandes de transferts d'argent vers des comptes bancaires étrangers ou de paiement en crypto-monnaie sont des tactiques courantes.

Il est difficile de tenir compte de ces éléments face à un scénario effrayant, mais cela pourrait vous éviter de tomber dans le piège.

Que faire si vous suspectez une arnaque par clonage vocal IA ?

Si vous recevez un appel ou un message vocal de vos proches en difficulté, gardez votre calme. Les fraudeurs misent sur votre panique et vos émotions, car cela augmente votre vulnérabilité face à leurs manipulations.

Si vous recevez un appel téléphonique

Si vous avez le moindre soupçon qu'un appel puisse être une arnaque par clonage vocal, raccrochez immédiatement. Ne divulguez aucune information et ne communiquez pas avec les escrocs. Recontactez plutôt votre proche sur un numéro que vous connaissez pour confirmer l'authenticité de l'appel de détresse.

Prolonger la conversation avec les escrocs augmente également le risque que votre voix soit enregistrée et clonée.

Si vous recevez un message vocal

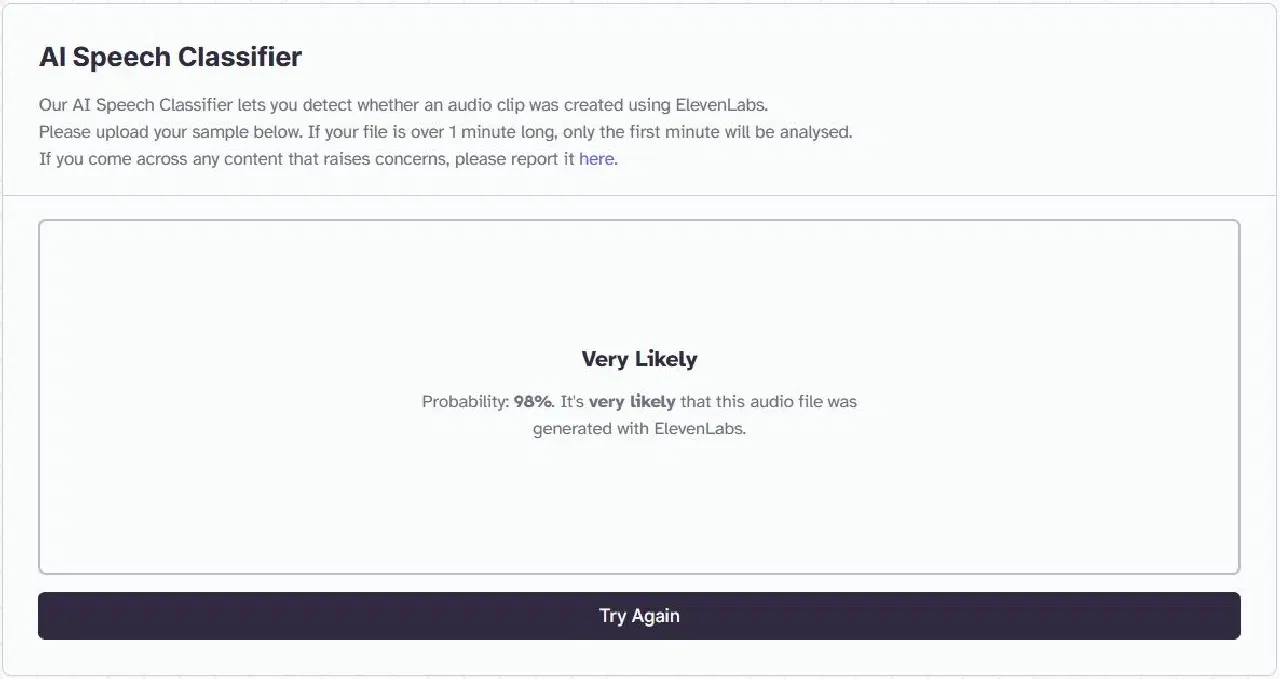

Si les fraudeurs ont laissé un message vocal, enregistrez immédiatement l'audio sur votre téléphone ou votre ordinateur. Cet échantillon audio peut être soumis à un outil de classification vocale IA pour déterminer s'il s'agit d'une voix humaine ou synthétique. Ces outils de classification fonctionnent de manière similaire aux détecteurs de texte IA. Téléchargez simplement le fichier audio, et le classificateur indiquera s'il a été généré par un humain ou par l'IA.

Le classificateur vocal d'ElevenLabs est un excellent outil pour cette vérification. ElevenLabs est à la base de nombreuses plateformes de clonage IA, ce qui en fait un outil idéal pour déterminer si une voix a été clonée. Voici comment l'utiliser pour identifier une voix clonée par l'IA :

Dans l'exemple ci-dessous, un message inquiétant a été enregistré par un humain et téléchargé sur le classificateur. On constate qu'il a été marqué comme ayant une probabilité de 2 % d'être manipulé.

Dans l'exemple suivant, le même message alarmant a été produit avec un outil de clonage vocal IA. À l'oreille humaine, les voix sont identiques. L'outil, en revanche, l'a classé avec une probabilité de 98 % d'être généré par l'IA.

Bien que ce classificateur ne soit pas infaillible, il peut confirmer vos soupçons concernant l'utilisation d'une voix clonée. Il est également impératif de contacter votre proche sur un numéro connu pour confirmation.

La prévention est la meilleure arme contre les escroqueries par clonage vocal IA

Parfois, la meilleure défense contre une escroquerie de haute technologie est une approche de basse technologie.

Établissez un mot de passe hors ligne connu uniquement de vos proches, de votre famille et de vos amis. En cas d'appel inquiétant, l'utilisation de ce mot de passe peut être un moyen sûr de confirmer l'identité de l'appelant.

Enfin, garder vos informations personnelles hors des plateformes sociales est un grand pas pour s'assurer que les escrocs ne peuvent pas recueillir suffisamment d'informations pour construire un récit crédible. N'oubliez pas : si vous ne voulez pas que tout le monde le sache, il est préférable de ne pas le partager sur les réseaux sociaux.