Le maintien de performances réseau saines est crucial, car des milliards de transferts de données se produisent chaque jour.

L’année 2020 a commencé avec environ 44 zettaoctets de données, soit environ 40 fois plus que le nombre total d’étoiles dans l’univers observable, selon le Forum économique mondial.

Et ce nombre va augmenter dans les prochains jours.

C’est un nombre insensé, mais vrai!

Par conséquent, il est impératif de s’assurer que votre réseau présente des performances adéquates pour répondre aux demandes croissantes.

Maintenant, l’éléphant dans la salle est la performance du réseau, qui dépend de certains facteurs, pour n’en nommer que quelques-uns – la latence, le temps jusqu’au premier octet (TTFB), la bande passante et le débit.

Si vous souhaitez maintenir un réseau stable et performant, vous devez optimiser ces facteurs. En plus de cela, ils vous aident également à éviter les sanctions des principaux navigateurs et moteurs de recherche.

Alors, préparez-vous à comprendre ces terminologies de réseau et comment vous pouvez les optimiser pour des performances élevées.

Table des matières

Qu’est-ce que la latence ?

Latence signifie littéralement retard.

Dans l’écosystème réseau, la latence est le temps mis par une requête ou des données pour voyager de sa source à sa destination. Ici, l’action d’un utilisateur est la demande et le temps qu’une application Web prend pour répondre à cette demande.

Ce délai inclut également le temps nécessaire à un serveur pour traiter la demande. Par conséquent, il est mesuré comme l’aller-retour – le temps total nécessaire à une demande pour être capturée et traitée par plusieurs appareils, puis reçue par l’utilisateur où elle est décodée.

Si les retards de transmission de données sont relativement faibles, c’est une faible latence, ce qui est souhaitable. Mais des délais plus longs ou une latence élevée ne sont pas souhaitables car ils détériorent l’expérience utilisateur.

Mais comment saurez-vous si votre réseau présente une latence élevée ?

Certains signes typiques incluent:

- Le site Web ou l’application prend une éternité à se charger

- L’accès aux serveurs et aux applications Web devient lent.

- L’envoi de certaines informations prend plus de temps, par exemple des e-mails avec des pièces jointes volumineuses.

Ainsi, lorsque vous rencontrez un tel signe, cela est probablement dû au réseau à latence élevée.

La latence du réseau est calculée en millisecondes (ms), et elle est inévitable car de multiples aspects influencent la façon dont les réseaux communiquent entre eux. Mais, vous pouvez réduire la latence en mettant en œuvre certaines mesures dont je parlerai dans les sections à venir.

Avant cela, discutons de la raison de la latence du réseau.

Quelles sont les causes de la latence ?

- Distance entre l’utilisateur faisant la demande et l’emplacement du serveur

- Les erreurs de serveur telles que l’erreur 50X peuvent affecter les performances des applications et peuvent également empêcher les visiteurs d’accéder à votre site Web.

- Mauvaise optimisation de la base de données principale, qui peut survenir en raison de bases de données surutilisées, de champs longs, de tables volumineuses, d’une mauvaise utilisation de l’index et de calculs compliqués.

- Problèmes matériels liés aux routeurs, points d’accès Wi-Fi, commutateurs, dispositifs de sécurité, équilibreurs de charge, pare-feu, IPS, etc.

- Les supports de transmission tels que les connexions sans fil, les câbles à fibres optiques, etc. ont des limites.

- En raison du faible espace mémoire, les systèmes d’exploitation ont du mal à maintenir les exigences de RAM utilisées par les programmes, ce qui a un impact sur les performances du système.

- Problèmes d’utilisateur final tels qu’un processeur faible ou un cycle de mémoire nécessaire pour obtenir une réponse dans des délais raisonnables

Comment mesurer la ⏱️ latence ?

Si vous utilisez des outils de surveillance réseau de marques telles que SolarWinds et Datadog, vous pouvez examiner automatiquement la latence du réseau.

Mais existe-t-il un moyen manuel pour cela?

La réponse est oui.

Ouvrez simplement l’invite de commande dans votre système d’exploitation et tapez ceci – tracert, puis tapez la destination que vous souhaitez interroger.

Après avoir tapé la commande, une liste avec tous les routeurs du chemin réseau menant à une adresse de site apparaît. Il affichera également un calcul de temps en millisecondes.

Additionnez simplement toutes les mesures pour obtenir la latence associée à votre réseau.

Il existe certaines méthodes pour mesurer la latence :

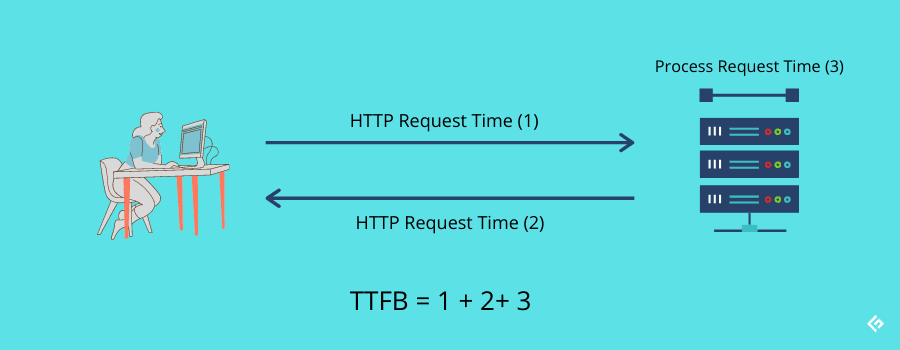

Temps jusqu’au premier octet (TTFB)

La différence de temps enregistrée entre le moment où une demande part de l’appareil d’un utilisateur et le moment où elle atteint la destination avec le « premier » octet de données est connue sous le nom de Time To First Byte (TTFB).

Le TTFB est également une mesure cruciale de la latence du réseau et de la réactivité du serveur.

Temps aller-retour (RTT)

Le temps total qu’un paquet de données prend pour se rendre de la source à sa destination, puis revenir à sa source est appelé temps d’aller-retour (RTT). Il peut fournir des résultats précis, mais les choses peuvent devenir floues lorsque les paquets de données empruntent un chemin de retour différent.

Test de ping

Généralement, l’administrateur système utilise des tests ping pour mesurer le temps nécessaire à 32 octets pour atteindre le serveur ainsi que le temps nécessaire à la réception de la réponse. Ces méthodes peuvent vérifier simultanément différents serveurs d’un réseau et signaler la latence et les performances globales.

Vous pouvez également effectuer un test de ping en ligne.

Comment améliorer la latence du réseau ?

Optimiser le routage

Utilisez des outils d’optimisation capables de résoudre efficacement la congestion de votre réseau pour améliorer le routage.

Vous pouvez également utiliser des amplificateurs ou des régénérateurs pour augmenter la vitesse du réseau si les problèmes résident dans le support de transmission.

Compression et mise en cache

Les adresses IP hautement distribuées parcourent de grandes distances, ce qui augmente le temps de transmission. Si vous gérez un serveur Edge situé à proximité de vos utilisateurs finaux, cela réduira le temps de déplacement et augmentera la vitesse de chargement des pages.

En dehors de cela, des techniques telles que l’optimisation des images et la compression des fichiers réduisent également la bande passante nécessaire pour transférer de gros volumes de données.

Appairage

Le peering signifie permettre à deux réseaux ou plus de se connecter et d’échanger du trafic direct sans payer un tiers pour la transmission du trafic sur le Web.

Alors, maintenez un réseau correctement connecté avec plusieurs chemins de réseau disponibles sur Internet.

Optimiser les protocoles réseau

Conformez-vous aux normes réglementaires en optimisant les protocoles réseau pour l’interopérabilité et la latence la plus faible.

Utiliser HTTP/2

HTTP/2 aide à réduire la latence du serveur grâce à des allers-retours moindres et des transferts parallélisés. En outre, vous devez également vous assurer d’un nombre minimal de requêtes HTTP externes, y compris les images ainsi que les fichiers JS et CSS.

Méthodes de prélecture

Bien que cela ne réduise pas nécessairement la latence du réseau, mais améliore les performances de votre site Web en termes de vitesse de chargement des pages.

Temps jusqu’au premier octet (TTFB)

Comme je l’ai déjà discuté, TTFB, qui est une métrique pour déterminer la réactivité du serveur, passons à ses autres aspects.

TTFB peut vous aider à identifier tous les points faibles existant dans votre processus de connexion. Si vous pouvez déterminer où se produisent les retards, vous pouvez ajuster vos services pour des performances plus rapides et fiables.

Sans oublier que le TTFB a également un impact sur le référencement ; par conséquent, il est également crucial pour votre visibilité en ligne.

Quels facteurs ont un impact sur le TTFB ?

Trois actions impactent le TTFB :

Envoi d’une requête au serveur

Une fois qu’un utilisateur a fait une demande, le serveur la reçoit en fonction de certains facteurs tels que le temps nécessaire à la recherche DNS, la vitesse du réseau, la distance du serveur, etc. et TTFB commence.

Traitement de la demande

Lors de la réception de la demande, le serveur doit traiter la demande et générer une réponse. Le processus commence par des appels à la base de données, des communications avec d’autres systèmes du réseau, l’exécution de scripts, etc.

Répondre

Ensuite, le serveur transmet sa réponse générée à l’utilisateur faisant la demande. Maintenant, cela dépend de la vitesse de connexion de l’utilisateur ainsi que du réseau de l’entreprise.

Ici, TTFB est la mesure du temps pendant lequel un utilisateur commence à recevoir la réponse à partir du premier octet.

Comment améliorer le TTFB ?

Réduire la latence

La latence peut se produire de n’importe quel côté ; votre serveur et/ou utilisateur. Bien que vous ne puissiez pas contrôler la vitesse de connexion des utilisateurs, vous pouvez certainement travailler sur la vitesse de votre serveur. Essayez de réduire la charge du serveur en tirant parti des CDN, qui peuvent placer le contenu statique à proximité des utilisateurs, ce qui augmente la vitesse de chargement des pages.

Résolution DNS rapide

Une résolution DNS ne devrait pas prendre plus de 100 millisecondes. Lorsque cela se produit, envisagez d’optimiser les paramètres DNS. Vous pouvez également changer de fournisseur DNS si les problèmes persistent.

Mettez à niveau l’hébergement de votre site Web

TTFB supérieur à 200 ms n’est pas bon pour votre site Web. Peut-être que la raison de la lenteur du TTFB est votre fournisseur d’hébergement de site Web en raison d’un réseau encombré et de serveurs surchargés.

Si tel est le cas, vous pouvez discuter avec le fournisseur d’hébergement à ce sujet ou mettre à niveau votre plan. Sinon, vous pouvez également déplacer votre site Web vers un autre fournisseur. Si vous utilisez WordPress, consultez ces plates-formes d’hébergement premium.

Améliorez les performances de votre backend

Si vous ne normalisez pas ou n’indexez pas correctement vos bases de données, cela pourrait ralentir le temps de réponse. Par conséquent, normalisez et indexez les bases de données pour les requêtes rapides. Il informera également votre base de données pour trouver rapidement les colonnes de table au lieu d’examiner chacune d’entre elles.

Mise en cache côté serveur

Réduisez la charge du processeur et les requêtes de base de données en conservant les fichiers et les données fréquemment nécessaires lus pour être transférés dans le cache du serveur.

Surveillance externe

Dans le cas où vous auriez optimisé votre TTFB en mettant en place quelques tactiques, c’est tant mieux !

Et vous voudrez toujours rester ainsi.

Mais les modifications apportées aux mises à jour logicielles, au matériel, aux mises à jour du site et autres peuvent entraîner une augmentation du TTFB. Alors, faites attention à ceux-ci avant qu’il ne soit trop tard.

Vous pouvez mettre en place des outils de suivi des performances du site. Cela vous aidera à réparer les choses rapidement si les performances vont au sud.

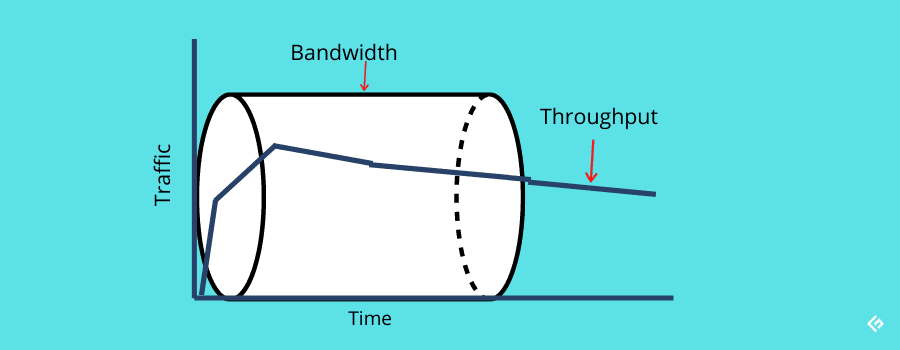

Qu’est-ce que la bande passante ?

La capacité maximale d’un réseau, y compris la taille du réseau et la capacité de traitement du serveur, est appelée bande passante.

En termes simples, c’est la mesure de la quantité de données qui peut être envoyée et/ou reçue à un moment donné. Il est mesuré en termes de bits/seconde, mégabits/seconde ou gigabits/seconde.

Facteurs affectant la bande passante

Une connexion Internet consiste en une bande passante maximale particulière. Certains facteurs peuvent limiter la bande passante d’un appareil spécifique, ce qui entraîne une connexion plus lente. Ces facteurs énumérés ci-dessous peuvent provenir de la nature de la connexion ou de l’ordinateur de l’utilisateur.

Utilisation d’Internet

La bande passante est affectée par le nombre total de tâches que vous effectuez sur votre appareil. En augmentant le nombre de tâches simultanément, la vitesse ralentit. Pensez donc à sérialiser vos tâches.

Bande passante en amont et en aval

Les données circulant DEPUIS un appareil sont en amont tandis que les données circulant VERS un appareil sont en aval.

En général, les processus Internet incluent une utilisation plus en aval qu’en amont ; par conséquent, les connexions Internet mettent davantage l’accent sur la bande passante en aval.

Ainsi, la bande passante est affectée lorsque le besoin d’une augmentation en amont lors de la transmission de données volumineuses, des chats vidéo, de l’accès à distance, des appels voix sur IP, etc.

Consommation de fond

La bande passante a un impact sur le nombre de téléchargements et de chargements simultanés sur votre appareil.

Connexion unique, plusieurs utilisateurs

À mesure que le nombre d’utilisateurs augmente dans un même réseau, cela augmente les charges du serveur et ralentit la transmission des données.

Distance du routeur

Si votre appareil est placé plus près du routeur, vous bénéficierez d’une bande passante plus élevée par rapport au cas où il est placé plus loin.

Comment améliorer la bande passante ?

Utiliser les paramètres QoS

Les paramètres de qualité de service (QoS) aident les réseaux à prendre en charge les applications importantes et commandent les règles de trafic pour hiérarchiser certains types de trafic. Par conséquent, les applications nécessaires n’ont pas à lutter pour la bande passante.

Les applications basées sur le cloud pourraient aider.

Passez au cloud pour améliorer les performances du réseau. Essayez d’externaliser certaines parties de votre trafic vers des réseaux cloud privés et publics et soulagez la pression de votre réseau.

Éliminer le trafic non essentiel

Vous pouvez bloquer le trafic non essentiel qui n’apporte aucune valeur à votre productivité pendant les heures de bureau. De cette façon, votre bande passante ne pourrait être utilisée que pour exécuter des opérations essentielles.

Mises à jour et sauvegardes périodiques

Les mises à jour et les sauvegardes de vos données et logiciels sont cruciales pour les performances ainsi que d’un point de vue sécurité. Mais ces processus occupent une énorme quantité de bande passante réseau.

C’est pourquoi vous devez les programmer stratégiquement, de préférence en dehors des heures normales de bureau.

Qu’est-ce que le débit ?

Le débit du réseau est la mesure de la quantité totale de données pouvant être transmises d’une source à la destination dans un laps de temps spécifié.

En d’autres termes, le débit mesure le nombre de paquets arrivés avec succès à une destination. Il est calculé en bits/seconde ou données/seconde.

Facteurs affectant le débit

Limitation d’un support de transmission

La bande passante ou capacité théorique associée à un support de transmission limite le débit.

Par exemple, si le débit de la bande passante est de 100 Mbps, il ne grimpera pas plus que cela, quoi qu’il arrive. En fait, les données pratiques envoyées seraient d’environ 95%, plus ou moins.

Congestion du réseau 🚸

Dans un réseau fortement encombré, le débit serait réduit.

Latence

Si la latence sur un réseau particulier est supérieure, le débit en souffrira.

Fonctionnement du protocole

Le protocole transportant et fournissant les paquets de données sur un réseau peut également affecter le débit.

Perte de paquets ou erreurs

Dans certains types de trafic, les erreurs et les pertes de paquets peuvent affecter le débit. C’est parce que ces paquets doivent être retransmis, ce qui réduit encore le débit.

La raison derrière les paquets compromis pourrait être des attaques de sécurité, des appareils endommagés, etc.

Si vous souhaitez mesurer le débit, vous pouvez utiliser des outils tels que Vents solaires, iPerf, Pingbetc.

Comment améliorer le débit ?

Minimiser la latence

L’une des premières choses à faire est d’essayer de minimiser la latence du réseau, car cela a un impact considérable sur les performances du réseau et entraîne une mauvaise expérience utilisateur.

Vous pouvez vous aider des sections mentionnées ci-dessus pour résoudre ce problème.

Éliminer les goulots d’étranglement du réseau

Évitez les goulots d’étranglement du réseau en mettant à niveau les routeurs, en réduisant le nombre total de nœuds qui raccourcissent la distance parcourue par les paquets. Par conséquent, il peut réduire la congestion pour un meilleur débit.

Gardez un œil sur les applications consommant trop de bande passante.

Si vous utilisez votre connexion Internet bien au-delà d’une juste part, le débit diminuera. Par conséquent, fermez les applications utilisant trop de bande passante à moins qu’elles ne soient nécessaires.

Redémarrez le réseau

Planifiez le redémarrage périodique de vos systèmes réseau comme le modem, les routeurs, etc. Ainsi, lorsqu’ils recommencent à fonctionner, ils peuvent afficher d’excellentes performances.

Vérifiez votre matériel

Ne laissez pas un matériel défectueux compromettre le débit. Alors, vérifiez votre matériel réseau pour trouver s’il y a une anomalie à cette fin.

Discutez avec votre FAI

Si tout est en place et que vous rencontrez toujours un faible débit, envisagez de le communiquer à votre fournisseur de services Internet (FAI). Peut-être que la faute est de leur côté.

Conclusion

J’espère que les choses sont un peu claires sur la latence, le TTFB, la bande passante et le débit de votre côté. Essayez de mettre en œuvre les trucs et astuces que j’ai mentionnés ci-dessus pour améliorer les performances de votre réseau.

Ensuite, devenez administrateur réseau.