Comment télécharger, installer et configurer Tensorflow sous Windows et Linux

TensorFlow, une initiative open source de Google, se positionne comme une plateforme incontournable pour l'apprentissage automatique et l'intelligence artificielle (IA). Elle offre un soutien précieux aux développeurs engagés dans ces domaines, en facilitant une multitude de tâches.

Avant de vous lancer dans l'utilisation de TensorFlow, il est essentiel de posséder une base solide en apprentissage automatique, et plus précisément en apprentissage profond.

Dans cet exposé, nous allons explorer les points clés de TensorFlow, ses fonctionnalités distinctives, et les méthodes rapides pour l'installer sous Windows et Linux.

Aperçu de TensorFlow

TensorFlow, une plateforme open source de premier plan, simplifie la mise en œuvre d'applications d'apprentissage profond et d'autres utilisations de l'apprentissage automatique.

Elle permet la création et le déploiement d'applications propulsées par l'apprentissage automatique. Si vous êtes confronté à un défi qui nécessite l'apprentissage automatique, TensorFlow est là pour vous aider.

TensorFlow met à disposition des outils pour concevoir et entraîner des modèles, en utilisant Python ou JavaScript. Bien que je ne sois pas développeur, la documentation est une mine d'informations pour comprendre son impact sur votre processus de déploiement d'applications d'apprentissage automatique.

Les atouts de TensorFlow

TensorFlow est reconnu pour ses nombreux avantages, que vous pouvez évaluer par vous-même en examinant ses principales fonctionnalités.

Si nous nous aventurons dans les avantages techniques, il serait nécessaire de les comparer à votre situation spécifique. Nous allons donc nous focaliser sur les fonctionnalités générales qui bénéficient au plus grand nombre.

1. L'ouverture du code source

Google a pris la décision d'ouvrir TensorFlow en 2015, permettant ainsi à la communauté de contribuer à son amélioration et d'assurer la transparence de son fonctionnement.

Les développeurs ont la possibilité de personnaliser la bibliothèque de diverses façons, ouvrant la voie à la résolution de problèmes insoupçonnés.

Sans cette approche open source, il est peu probable que ce framework aurait atteint sa popularité actuelle.

2. Débogage simplifié

TensorFlow est conçu pour faciliter la création de modèles. Ainsi, une expérience de débogage fluide est un élément central de son approche.

L'interface utilisateur intuitive est un avantage supplémentaire qui améliore l'expérience globale.

3. Prise en charge des CPU et des GPU

Avec TensorFlow, vous avez la liberté de choisir d'exécuter le calcul des données sur un CPU ou un GPU. L'utilisation d'un GPU accélère généralement les opérations d'apprentissage profond par rapport à un CPU.

Par conséquent, si votre équipement inclut un GPU puissant, TensorFlow vous permet d'en exploiter pleinement le potentiel.

4. Des API d'apprentissage automatique utiles

Les API permettent aux développeurs d'intégrer une multitude de fonctions dans leurs applications. TensorFlow offre une collection d'API stables et fiables.

Certaines de ces API peuvent même apporter des améliorations en termes de performance. Selon les informations officielles, vous ne devriez pas rencontrer de difficultés avec celles disponibles en Python. Si vous utilisez d'autres langages, il est recommandé de vérifier leur compatibilité auprès des équipes de TensorFlow.

5. Des modèles prêts à l'emploi pour la production

TensorFlow met à disposition divers modèles pré-entraînés. Que vous soyez un expert ou un novice, vous pouvez les utiliser pour gagner du temps et accélérer la création de modèles d'apprentissage automatique.

En plus de ces fonctionnalités, vous bénéficiez de flexibilité, de simplicité d'utilisation, d'une palette d'outils de visualisation et bien d'autres atouts qui peuvent optimiser votre processus de développement en apprentissage automatique.

Maintenant que vous avez une idée précise de TensorFlow, voyons comment le télécharger, l'installer et le configurer sur vos systèmes Windows et Linux.

Examinons les détails ci-dessous.

Téléchargement et configuration de TensorFlow

Contrairement à d'autres logiciels, TensorFlow ne se présente pas sous la forme d'un fichier d'installation .exe. Vous devrez principalement télécharger le package via un gestionnaire de packages recommandé.

En résumé, différentes méthodes d'installation existent. Elles peuvent être regroupées comme suit :

- Utilisation de Miniconda et pip

- Utilisation de Miniconda et pip sur WSL 2

- Utilisation d'un conteneur Docker

- Compilation à partir des sources

Installation de TensorFlow sous Windows

Contrairement à d'autres logiciels, il n'y a pas de fichier d'installation .exe. L'installation se fait via un gestionnaire de packages.

#1. Utilisation de Miniconda et pip (méthode préconisée)

Important : Au moment de la rédaction de ce guide, TensorFlow 2.10 est la dernière version qui assure une prise en charge native du GPU sous Windows. Pour les versions plus récentes, TensorFlow suggère une installation dans WSL 2, ce que nous aborderons par la suite.

Pour bénéficier du support GPU de TensorFlow, l'utilisation de Miniconda (installateur du gestionnaire de packages conda) est fortement recommandée.

Miniconda permet de créer un environnement isolé, évitant ainsi les conflits avec d'autres applications sur votre système.

Pour débuter, téléchargez le dernier installateur Windows de Miniconda et suivez les instructions à l'écran pour mener à bien l'installation.

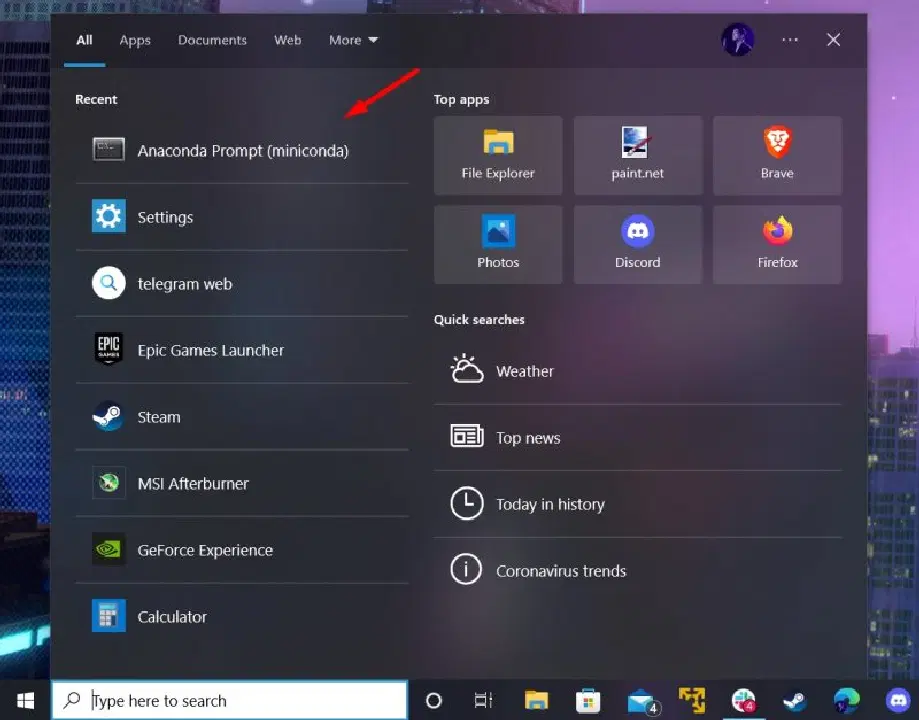

Une fois cette étape complétée, lancez l'invite de commande Miniconda comme illustré sur la capture d'écran :

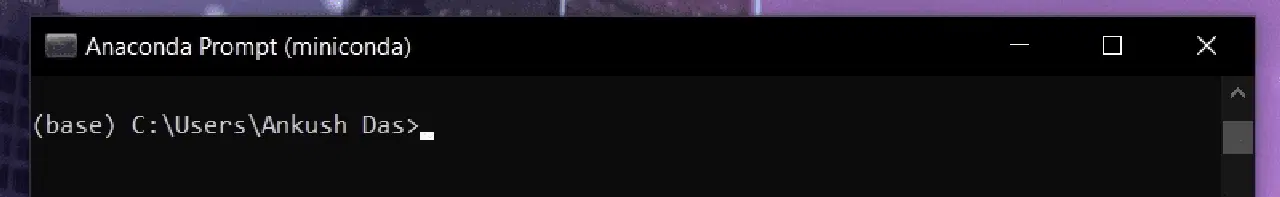

Voici son aspect :

Après l'apparition de la fenêtre d'invite Anaconda, saisissez la commande ci-après pour vérifier que le gestionnaire de packages conda est à jour :

conda update -n base -c defaults conda

Ceci étant dit, voici les étapes à suivre pour installer TensorFlow :

Commencez par créer un nouvel environnement (nommé tf) :

conda create --name tf python=3.9

Astuce : Vous pouvez l'activer/désactiver avec les commandes : conda activate tf et conda deactivate

Vous devez l'activer pour continuer. Pour activer le support GPU, assurez-vous que votre pilote graphique (GPU NVIDIA) est installé, puis installez les packages suivants via la commande :

conda install -c conda-forge cudatoolkit=11.2 cudnn=8.1.0

Cela téléchargera environ 1 Go de packages, qui comprennent des outils permettant le déploiement d'applications d'apprentissage automatique avec GPU et réseau neuronal profond.

Enfin, utilisez le gestionnaire de packages pip pour installer le package TensorFlow. Vous pouvez utiliser conda pour cette installation, mais la dernière version stable pourrait ne pas être disponible.

Avant de continuer, vérifiez que pip est à jour via la commande :

pip install --upgrade pip

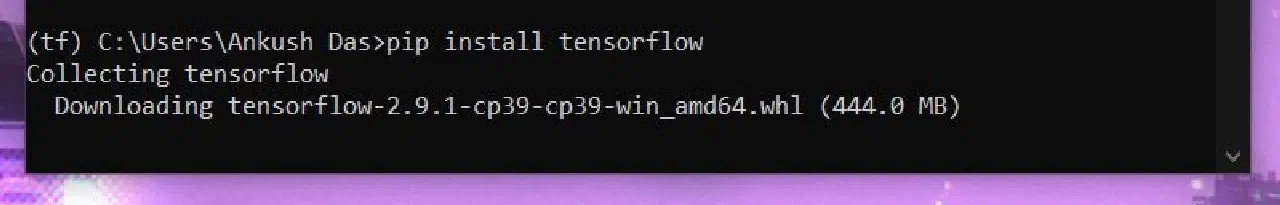

Une fois cette vérification faite, installez TensorFlow avec :

pip install tensorflow

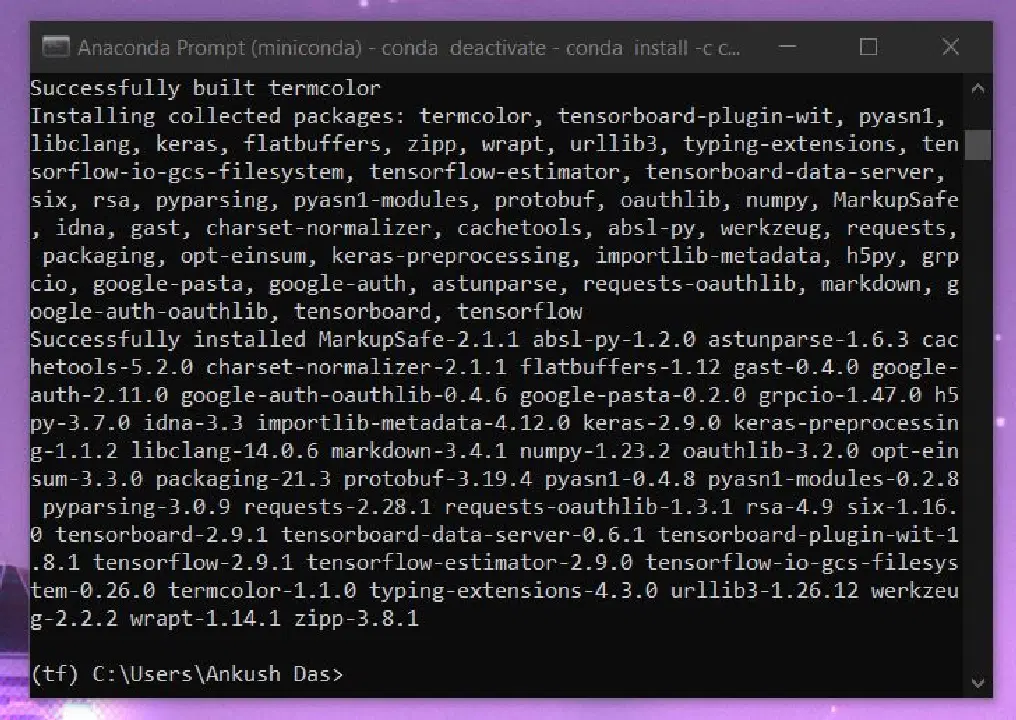

Vous remarquerez que plusieurs packages sont compilés/installés. Cela peut sembler bloqué, mais patientez, le processus reprendra et l'installation se terminera.

#2. Utilisation de Conda et pip sur WSL 2

En partant du principe que WSL 2 est configuré sur votre système, vous pouvez installer TensorFlow avec les commandes suivantes dans le terminal de la distribution :

conda install -c conda-forge cudatoolkit=11.2 cudnn=8.1.0

export LD_LIBRARY_PATH=$LD_LIBRARY_PATH:$CONDA_PREFIX/lib/

python3 -m pip install tensorflow

# Vérification de l'installation:

python3 -c "import tensorflow as tf; print(tf.config.list_physical_devices('GPU'))"

Vous pouvez coller l'ensemble des commandes, elles seront traitées les unes après les autres.

Si WSL 2 n'est pas installé, ouvrez l'invite de commande avec un accès administrateur et entrez :

wsl.exe --install

Ceci téléchargera Ubuntu et activera la fonctionnalité WSL pour votre système. Le redémarrage de votre PC sera nécessaire.

Si vous ne trouvez pas Ubuntu, vous pouvez l'installer via le Microsoft Store.

#3. Compilation à partir des sources

TensorFlow étant open source, vous avez la possibilité de le compiler à partir de zéro en adaptant les options de configuration.

Cette méthode est conseillée aux utilisateurs avancés, qui maîtrisent l'ensemble des options et des détails de la configuration. Consultez la documentation officielle pour plus d'informations.

Installation de TensorFlow sous Linux

Comme sous Windows, TensorFlow s'installe via Miniconda et pip, ou par une compilation à partir des sources.

Voyons comment procéder :

#1. Utilisation de Miniconda et pip (méthode recommandée)

Remarque : Les commandes sont identiques à Windows. Seule la méthode d'installation de Miniconda diffère sous Linux.

Voici comment installer Miniconda sous Linux via le terminal :

curl https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh -o Miniconda3-latest-Linux-x86_64.sh bash Miniconda3-latest-Linux-x86_64.sh

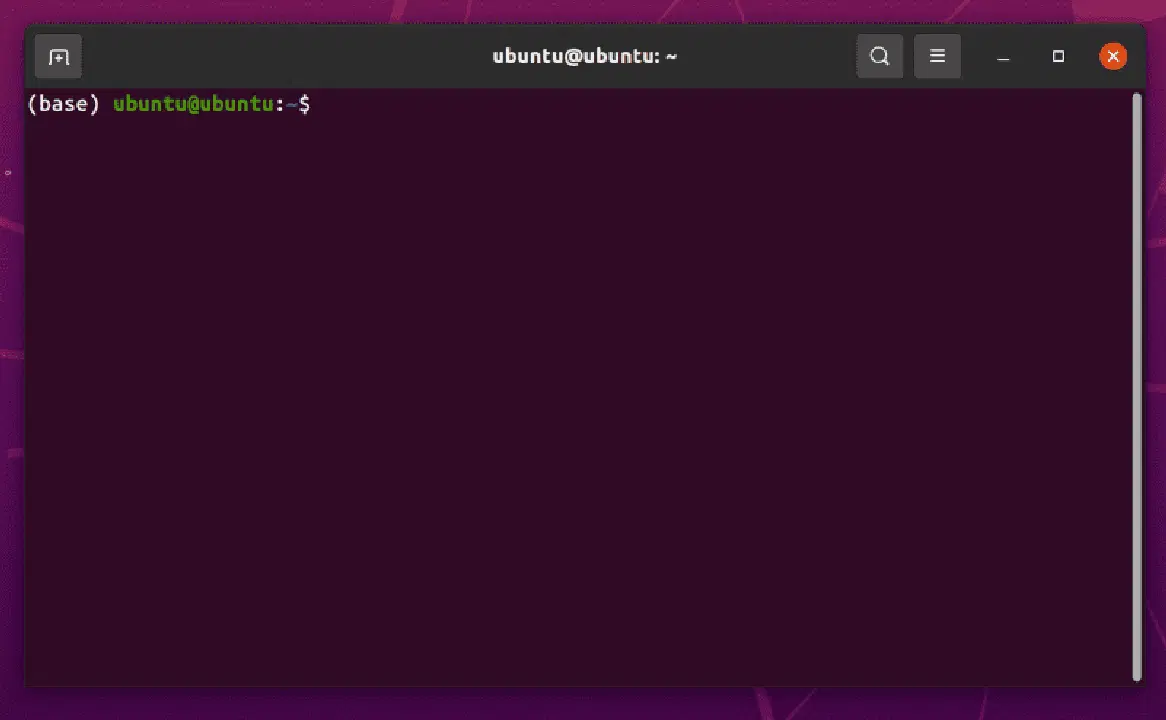

Redémarrez le terminal de votre distribution Linux pour observer quelque chose comme ceci :

La mention (base) avant les variables d'invite du terminal indique que conda est actif et installé.

Ne le désactivez pas tant que l'installation de TensorFlow n'est pas terminée.

Vous pouvez reprendre les étapes décrites pour Windows. Vous pouvez également utiliser la commande suivante pour installer TensorFlow :

conda install -c conda-forge cudatoolkit=11.2 cudnn=8.1.0

export LD_LIBRARY_PATH=$LD_LIBRARY_PATH:$CONDA_PREFIX/lib/

python3 -m pip install tensorflow

# Vérification de l'installation:

python3 -c "import tensorflow as tf; print(tf.config.list_physical_devices('GPU'))"

Sous Linux, des problèmes peuvent survenir avec le pilote GPU. Consultez la documentation de NVIDIA pour en savoir plus.

#2. Compilation à partir des sources

Comme pour Windows, la compilation à partir des sources est une méthode complexe sous Linux et est réservée aux utilisateurs avertis.

Si vous êtes débutant, il est préférable de ne pas opter pour cette approche sauf si vous avez un besoin spécifique. La documentation est une excellente source d'informations.

Installation de TensorFlow avec Docker (Windows et Linux)

Docker permet d'installer TensorFlow sans problème, quelle que soit la plateforme.

Assurez-vous que Docker est installé sur votre système, ou référez-vous à notre guide d'installation Docker pour vous aider.

Une fois l'installation réalisée, entrez la commande suivante depuis Docker :

docker pull tensorflow/tensorflow

Vous devez avoir une certaine expérience avec les conteneurs Docker afin de démarrer un conteneur avec les configurations appropriées à votre usage.

Pour la prise en charge spécifique du GPU ou pour télécharger une version différente de TensorFlow, consultez la documentation officielle.

Voici la commande à exécuter avec Docker :

docker run [-it] [--rm] [-p hostPort:containerPort] tensorflow/tensorflow[:tag] [command]

Conclusion

L'installation de TensorFlow est une opération ponctuelle qui, avec ce guide, devrait se dérouler sans difficulté pour la majorité des utilisateurs.

Si vous avez des configurations existantes ou des versions antérieures de Python ou Conda, mettez-les à jour pour une installation réussie de TensorFlow.

Vous pouvez également explorer les meilleures plateformes d'IA pour développer des applications d'IA et d'apprentissage automatique.